Специалисты в области искусственного интеллекта провели анализ главных угроз человечеству, исходящих от искусственного интеллекта.

Об этом говорится в отчете “The Malicious Use of Artificial Intelligence: Forecasting, Prevention, and Mitigation”.

В отчете, в частности, говорится, что катастрофические сценарии могут реализоваться искусственным интеллектом намного быстрее, чем кажется.

Так, в исследовании описаны ключевые риски, связанные с развитием технологий и способы их предотвращения. В общей сложности разработкой отчета занимались более 20 футурологов, экспертов по искусственному интеллекту и правозащитников: представители института будущего человечества, центра изучения экзистенциальных рисков, Фонда электронных рубежей и лаборатории OpenAI.

В отчете описаны возможные сценарии применения искусственного интеллекта для совершения преступлений в ближайшие пять лет: большинство из них связаны со слежкой, нарушением приватности и искажением реальности. Алгоритмы на основе машинного обучения смогут выполнять различные задачи быстрее и дешевле, чем человек.

По мнению специалистов, следует обратить внимание на возможную угрозу, исходящую от фишинговых операций. В частности, чатботы научатся имитировать манеру речи близкого лица или родственника, а также могут начать генерацию фальшивого видеоконтента, к примеру, для общения в мессенджере.

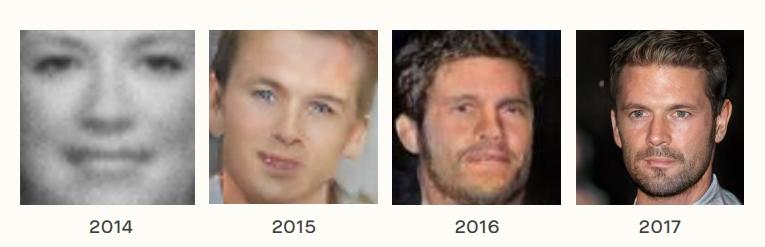

Фото: Фотографии, созданные искусственным интеллектом

Помимо этого, не исключается возможность применения ИИ для слежки, – наблюдения и контроля действий и публикаций пользователя в Сети.

В исследовании также имеются соответствующие рекомендации. Несмотря на это, как сообщает MIT Technology Review, большинство из абстрактны, так как эксперты советуют обсуждать проблему, исследовать риски и уделять больше внимания этике при подготовке специалистов в соответствующей отрасли.

Читайте также: Три волны автоматизации: как роботы изменят рынок труда

“Развитие ИИ представляет собой особенно сложную проблему, поскольку новые методы и инструменты получают широкое распространение и становятся все более удобными в использовании”, – говорится в сообщении.

Также приводится комментарий одного из авторов исследования, озвучившего целью создания такого отчета.

“У нас не было задачи нарисовать мрачную картину — можно придумать много вариантов защиты, и нам еще многому стоит поучиться. Наше исследование не описывает безнадежность ситуации. Оно призывает к действию”, – сказал Майлз Брангейд.

19 февраля Google начал тестирование бота, способного освободить пользователей от необходимости постоянно набирать текст в мессенджерах.

13 февраля исследователи из Университета Брауна и Массачусетского технологического института разработали метод, который позволит роботам планировать многоступенчатые задачи на основе абстрактных представлений об окружающем мире. Это поможет создавать думающие машины.

8 февраля пользователь популярного американского портала Reddit под ником Deepfakes опубликовал видео, на котором показал, как с помощью бесплатных ИИ-алгоритмов, доступных в Сети, и подержанного ноутбука за $500 он убрал усы супермена из “Лиги справедливости”. Причем результат оказался лучше, чем у специалистов Голливуда.

Держава змінює правила тютюнового та алкогольного ринку: Гетманцев про свій законопроєкт, економіст – критикує

Держава змінює правила тютюнового та алкогольного ринку: Гетманцев про свій законопроєкт, економіст – критикує